ExecuTorch 运行时概述¶

本文档讨论了 ExecuTorch 运行时环境的设计,该环境可在智能手机、可穿戴设备和嵌入式设备等边缘设备上执行 ExecuTorch 程序文件。主执行 API 的代码位于

executorch/runtime/executor/。

在阅读本文档之前,我们建议您阅读 ExecuTorch 的工作原理。

在最高层级上,ExecuTorch 运行时负责:

正在加载由模型降低过程的

to_executorch()步骤生成的二进制.pte程序文件。执行实现降低模型的指令序列。

请注意,截至 2023 年底,ExecuTorch 运行时仅支持模型推理,尚不支持训练。

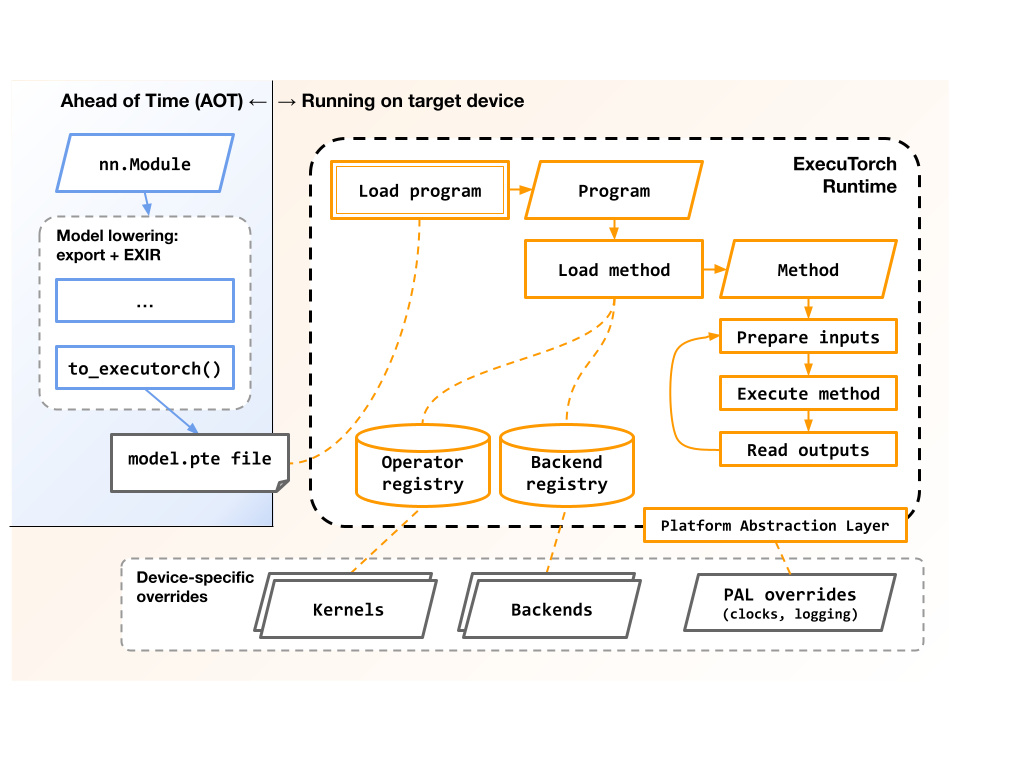

此图展示了导出和执行 ExecuTorch 程序的高级流程及所涉及的组件:

运行时还负责:

管理加载和执行过程中使用的内存,可能涉及多个存储体(如 SRAM 和 DRAM)。

将像

"aten::add.out"这样的符号操作符名称映射到实现这些操作符语义的具体 C++ 函数或 内核。将模型的预定部分分派给 后端代理 以加速处理。

可选地在加载和执行期间收集 分析数据。

设计目标¶

ExecuTorch 运行时旨在在各种边缘设备上运行,从现代智能手机 CPU 到资源受限的微控制器和 DSP。它对委派执行到一个或多个后端以利用特定架构的优化和现代异构架构提供了首要支持。它小巧且便携,足以直接在没有操作系统、动态内存或线程的裸机嵌入式环境中运行。

低执行开销¶

内存¶

在不包含内核或后端的情况下构建时,核心运行时库的大小小于 50kB。

常量张量直接指向

.pte文件数据,避免了该数据的复制。这些数据块的对齐方式可以在.pte创建时进行调整。后端委托方可以在模型初始化后卸载其预编译数据,从而降低峰值内存占用。

可变张量的内存布局会提前规划,并打包到一组用户分配的缓冲区中,从而提供对内存位置的细粒度控制。这在具有异构内存层次结构的系统上尤其有用,允许将数据放置到(例如)靠近将操作该数据的核心的 SRAM 或 DRAM 中。

CPU¶

模型执行是对指令数组的简单循环,其中大多数是指向内核和后端委托的函数指针。这使得执行开销极小,每个操作仅需微秒到纳秒量级。

操作(如“add”或"conv3d")的实现可以针对特定目标系统进行完全自定义,而无需修改原始模型或生成的

.pte文件。

熟悉的 PyTorch 语义¶

ExecuTorch 是 PyTorch 技术栈中的一流组件,并尽可能复用其 API 和语义。

ExecuTorch 使用的 C++ 类型与核心 PyTorch 的

c10::和at::库中的相应类型源代码兼容,并且 ExecuTorch 提供了aten_bridge用于在两者之间进行转换。这对于已经使用 PyTorch C++ 类型的项目可能会有所帮助。像

aten::add和aten::sigmoid这样的算子的语义在 ExecuTorch 和核心 PyTorch 之间是相同的。ExecuTorch 提供了一个测试框架来确保这一点,并帮助测试这些算子的未来实现。

可移植的代码和架构¶

ExecuTorch 运行时在设计时充分考虑了可移植性,因此用户可以为多种目标系统构建它。

C++ 语言注意事项¶

该代码兼容 C++17,以便与旧版工具链配合使用。

运行时不使用异常或 RTTI,尽管它并不排斥它们。

该代码兼容 GCC 和 Clang,并且也已使用多种专有嵌入式工具链构建。

该仓库提供 CMake 构建系统,以简化集成过程。

操作系统注意事项¶

运行时没有直接的系统调用。对内存、文件、日志和时钟的所有访问都通过运行时平台抽象层

(PAL) 和注入的接口如

DataLoader 和 MemoryAllocator 进行抽象。请参阅 运行时 API 参考 以了解更多。

应用程序可以通过 MemoryManager、

MemoryAllocator、HierarchicalAllocator 和 DataLoader 类控制所有内存分配。核心运行时不会直接调用 malloc() 或 new,也不会调用像 std::vector 这样在底层进行分配的类。这使得以下操作成为可能:

在无堆环境中运行,但如需要仍可使用堆。

避免在模型加载和执行期间对堆进行同步。

控制不同类型数据所使用的内存区域。例如,一组可变张量可以驻留在 SRAM 中,而另一组则驻留在 DRAM 中。

轻松监控运行时使用的内存量。

然而,请注意,特定的内核或后端实现可能会使用任意的运行时或操作系统功能。用户应仔细查阅其所使用的内核和后端库的文档。

线程考虑因素¶

核心运行时不进行线程管理或加锁,也不使用线程局部变量。但它能与更高层级的同步机制良好协作。

每个

Program实例是不可变的,因此 完全线程安全。 多个线程可以同时访问单个Program实例。每个

Method实例是可变但自包含的,因此 有条件地线程安全。 多个线程可以同时访问和执行独立的Method实例,但对单个实例的访问和执行必须序列化。

然而,请注意:

在

Program::load_method()期间可能会读取两个全局表:内核注册表和后端注册表。在实践中,这些表仅在进程/系统加载时进行修改,并在加载第一个

Program之前实际上被冻结。但某些应用程序可能需要了解这些表,特别是如果它们在进程/系统加载后手动修改它们。

特定的内核或后端实现可能有其自身的线程限制。用户应仔细查阅其所使用的内核和后端库的文档。

进一步阅读¶

有关 ExecuTorch 运行时的更多详细信息,请参阅: